Le LHC ou comment se rapprocher du Big Bang Understand article

Traduit par Ruby Veerapen. Le matin du 10 septembre 2008, à 10:28, le LHC (Large Hadron Collider), plus grand accélérateur de particule au monde, a été mis en route. Pourquoi? Rolf Landua du CERN et Marlene Rau de l'EMBL, dans le premier de deux articles sur la question, reviennent sur les…

Image reproduite avec l’aimable

autorisation de CERN

Lorsque l’Univers s’est formé il y a 13,7 milliards d’années lors du Big Bang, une gigantesque concentration d’énergie a été transformée en matière en moins d’un milliardième de seconde. Les températures, les densités et les énergies mises en jeu étaient incroyablement élevées. Dans la fameuse loi d’Einstein, E=mc2, la vitesse de la lumière, c, définit le taux d’échange de la transformation par laquelle une particule de matière d’une certaine masse, m, est créée à partir d’une quantité d’énergie, E, correspondante. Au vu de cette relation, les énergies élevées présentes juste après le Big Bang sont susceptibles d’avoir créé des particules extrêmement massives. Les physiciens ont émis l’hypothèse de l’existence de ces particules en réponse aux questions ouvertes sur la création et la composition de notre Univers.

C’est pour étudier la validité de ces théories que le LHC a été construit car on peut supposer que tout type de particule créée en son sein existait au tout début de l’Univers, juste après le Big Bang. Accélérées aux énergies les plus élevées atteignables grâce à la technologie actuelle (de l’ordre de celles calculées comme ayant existé 10-12 secondes après le Big Bang), des particules entreront en collision dans le LHC à une vitesse voisine de celle de la lumière. Ce processus devrait produire de nouvelles particules plus massives qu’aucune autre jamais créée au cours d’expériences et ainsi permettre aux physiciens de mettre leurs hypothèses à l’épreuve. Cependant, malgré ce qu’ont laissé entendre les médias, l’énergie à laquelle s’effectueront ces collisions sera environ 1075 fois plus faible qu’au moment du Big Bang, si bien que les craintes de recréer un «Mini Bang» sont infondées.

Les constituants élémentaires de la matière: le modèle standard

Depuis l’époque des philosophes grecs, l’homme se demande de quoi est fait le monde. Est-il possible d’expliquer simplement l’immense diversité des phénomènes naturels, roches, plantes, animaux (nous y compris), nuages, tonnerre, étoiles, planètes et tout le reste? Les théories et découvertes des physiciens au cours du siècle dernier nous ont donné une réponse: tout dans l’Univers est le fruit d’un petit groupe de constituants élémentaires appelés particules de matière, gouvernés par quatre forces fondamentales. Le modèle standard des particules et des forces décrit, dans la mesure de nos connaissances actuelles, la manière dont ces particules et forces sont liées (voir image). Développé au début des années 1970, il a fait ses preuves et le statut de véritable théorie physique lui est désormais acquis.

des particules. Cliquer sur

l’image pour l’agrandir

Image reproduite avec l’aimable

autorisation de CERN

Les particules de matières sont de taille infinitésimale (pas plus grandes que 10-19 m, soit un milliard de fois plus petites que le diamètre d’un atome). Elles peuvent appartenir à l’une des deux catégories suivantes: les leptons et les quarks. L’ensemble comprend douze types de particules divisés en trois familles, chacune constituée de deux leptons et deux quarks. La famille fondamentale, qui contient un quark up (u), un quark down (d), un électron et un neutrino (ces deux derniers étant les leptons), suffit à rendre compte du monde visible. Les huit autres particules de matière constituant les deux autres familles sont instables et ne semblent différer de la famille fondamentale que par leurs masses plus élevées. Si le Prix Nobel de Physique de 2008 a été attribué pour une théorie expliquant l’existence de ces autres particulesw1, les physiciens n’ont toujours pas d’explication quant à la raison pour laquelle il y en a exactement huit.

Les particules de matière peuvent «communiquer» entre elles de différentes manières, certaines cumulant jusqu’à quatre interactions. Pour ce faire, elles échangent différents types de particules messagères appelées bosons. À chaque interaction est associée un boson spécifique, une sorte de petit paquet d’énergie aux propriétés uniques. L’intensité et la portée de ces quatre interactions (ou forces fondamentales) sont responsables de la hiérarchisation de la matière.

Trois quarks liés par l’interaction forte, dont la portée est courte, forment ce qu’on appelle des hadrons. On peut citer, par exemple, les protons (deux quarks up et un quark down) et les neutrons (un quark up et deux quarks down) du noyau atomique. Les charges des quarks up et down (+2/3 et –1/3 respectivement) expliquent ainsi la charge positive des protons et la neutralité des neutrons.

Alors à l’échelle de l’atome, comment les électrons sont-ils attirés vers le noyau? Les protons et les électrons ayant des charges opposées, ils s’attirent mutuellement grâce à une interaction de longue portée: l’interaction électromagnétique. Les électrons, beaucoup plus légers que le noyau, orbitent autour de ce dernier ce qui crée un atome. Plusieurs atomes peuvent ensuite former des molécules, à la base de toute vie dans l’Univers.

Toutes ces particules possédant une masse, elles s’attirent également à travers l‘interaction gravitationnelle. Cependant, cette force à longue portée est si faible (plus faible que l’interaction électromagnétique d’environ 38 ordres de grandeur) qu’elle ne joue un véritable rôle que lorsqu’un grand nombre de particules s’assemblent. C’est l’attraction gravitationnelle combinée de tous les protons et neutrons de la Terre qui nous maintient les pieds au sol.

Enfin, il y a l’interaction faible, en vérité plus intense que la gravité mais la plus faible des trois autres interactions. De très courte portée, elle permet des transformations entre types de quarks ou types de leptons. Sans ces transformations, il n’y aurait pas de radioactivité par désintégration bêta au cours de laquelle un neutron devient proton, c.-à-d. où un quark down se transforme en quark up (pour plus de détails sur la radioactivité par désintégration bêta, voir Rebusco et al, 2007). Qui plus est, le soleil ne brillerait pas, car les étoiles puisent l’énergie qu’elles irradient d’un processus de fusion (pour de plus amples explications, voir Westra, 2006), au cours duquel un proton devient neutron grâce à la transformation d’un quark up en quark down; c’est, en d’autres termes, le processus inverse de la désintégration bêta.

Bien que le modèle standard ait apporté beaucoup à la physique en aidant les physiciens à comprendre les lois fondamentales qui régissent la Nature, il ne suffit pas à démêler toute l’histoire. Nombre de questions restent sans réponse et les expériences menées au LHC visent à apporter des solutions à certains des problèmes auxquels se heurtent les scientifiques.

Un problème «massif»: le champ de Higgs

de l’expérience CMS qui pourrait

permettre de découvrir le boson

de Higgs pour l’instant insaisissable

Image reproduite avec l’aimable

autorisation de CERN

Une des questions ouvertes est la suivante: pourquoi les particules (est par conséquent la matière) ont-elles une masse? Si les particules n’avaient pas de masse, aucune structure n’existerait dans l’Univers, car tout serait fait de particules individuelles sans masse se déplaçant à la vitesse de la lumière. Et pourtant, que les particules aient une masse pose des problèmes mathématiques.

Dans les années 1960, une idée a été développée pour réunir les interactions faible et électromagnétique au sein d’une même et puissante théorie selon laquelle l’électricité, le magnétisme, la lumière et certains types de radioactivité, sont tous des manifestations d’une unique force sous-jacente appelée, sans surprise, la force électrofaible. Mais pour que cette unification fonctionne sur le plan mathématique, il faut que les particules porteuses de ces forces aient une masse. Or, leur donner une masse en termes mathématiques n’était pas évident. C’est en 1964 que les physiciens Peter Higgs, Robert Brout et François Englert ont proposé une solution à cette énigme. Ils ont émis l’hypothèse que la masse des particules était due à leur interaction avec un champ de force invisible s’étendant sur tout le cosmos: le champ de Higgs. Selon cette hypothèse, une particule messagère, appelée le boson de Higgs, est associée à ce champ. Toute particule interagissant avec ce dernier (cette interaction s’apparentant à une sorte de friction) obtient ainsi une masse. Plus les particules interagissent avec ce champ, plus elles acquièrent de la masse. À contrario, les particules n’interagissant jamais avec le champ de Higgs demeurent sans masse (voir le dessin).

sur l’image pour l’agrandir

Image reproduite avec l’aimable

autorisation de CERN

Cette idée a donné à la physique une façon satisfaisante de combiner les théories déjà établies aux phénomènes observés. Le hic est que ce fameux boson n’a toujours pas été détecté. Ce qui rend sa détection si difficile (à supposer qu’il existe bel et bien) c’est que la théorie ne prédit pas sa masse; il faut donc chercher la particule en tâtonnant.

Lors de collisions à haute énergie, les physiciens créent de nouvelles particules et cherchent parmi elles le boson de Higgs. La quête dure depuis 30 ans maintenant, les collisions se faisant à des énergies de plus en plus élevées. Cependant, la particule nous échappe toujours; on peut supposer que les énergies utilisées jusqu’à maintenant n’ont pas été suffisamment élevées. D’après nos connaissances actuelles, la particule de Higgs devrait être au moins 130 fois plus massive que le proton. Les scientifiques pensent que l’énergie générée dans le LHC (plusieurs fois supérieure à celles utilisées à ce jour lors d’expériences similaires) devrait suffire à détecter le boson de Higgs.

Deux des expériences au LHC, appelées ATLAS et CMS, ont pour objectif de détecter des traces provenant de la désintégration de la particule de Higgs que l’on pense être très instable. Prouver son existence serait une avancée d’envergure pour la physique des particules car cela permettrait de compléter notre compréhension de la matière. À contrario, si le boson de Higgs n’est pas découvert, deux hypothèses seront à envisager. La première serait qu’il est trop lourd pour être détecté par le LHC et la deuxième qu’il n’existe tout simplement pas. Dans le cas de la dernière hypothèse, il se pourrait qu’une des théories concurrentes s’avère finalement exacte. Autrement, les théoriciens de la physique devront retourner à leurs tableaux pour repenser une toute nouvelle théorie expliquant l’origine de la masse.

La face cachée de l’Univers

Il est un autre aspect important de la physique des particules que le modèle standard n’explique pas: les observations récentes ont révélé que tout ce que nous «voyons» dans l’Univers (étoiles, planètes, poussière) ne représente que 4% de la somme totale de sa masse et de son énergie (sous forme de radiation et de champs vides tels que le champ de Higgs). La majeur partie de l’univers cependant, est cachée, constituée de substances invisibles qui n’émettent pas de radiations électromagnétiques, si bien qu’on ne peut pas les détecter directement via des télescopes ou autres instruments similaires. Ces substances n’interagissent avec la matière «normale» qu’à travers la gravité et non grâce aux trois autres forces fondamentales. Ceci implique qu’on ne peut les détecter qu’en repérant leurs effets gravitationnels ce qui les rends très difficiles à étudier. Ces substances mystérieuses sont connues sous les noms d’énergie et de matière noires (comme explicité dans Warmbein, 2007, et Boffin, 2008).

«anneau» fantomatique de matière

noire dans l’amas galactique

Cl 0024+17 (ZwCl 0024+1652).

Photo prise par le télescope

spatial Hubble

Image reproduite avec l’aimable

autorisation de la NASA, de l’ESA,

de M.J. Jee et de H. Ford (Johns

Hopkins University); source:

Wikimedia Commons

Les observations récentes laissent à penser qu’environ 26% de l’Univers est fait de matière noire. Les premières indications de son existence remontent à 1933, lorsque des observations astronomiques et des calculs d’effets gravitationnels ont révélé qu’il devait y avoir «autre chose» à l’intérieur et autour des galaxies que ce que les télescopes pouvaient détecter. De nos jours, les chercheurs pensent que non seulement l’effet gravitationnel de la matière noire permet au galaxies de tourner sur elles-mêmes plus vite que ne le laisserait penser leur masse observable, mais que le champ gravitationnel de la matière noire détourne la lumière des objets se trouvant derrière elle (phénomène de lentille gravitationnelle; pour une brève description des lentilles gravitationnelles, voir Jørgensen, 2006). Ces effets peuvent être mesurés et utilisés pour estimer la densité de la matière noire même si aucune observation directe n’est possible.

Mais qu’est-ce que la matière noire? Une hypothèse est qu’elle serait constituée de particules supersymétriques, un ensemble hypothétique de particules partenaires des douze particules décrites par le modèle standard (voir schéma).

Le concept de supersymétrie postule que pour chacune des particules de matière ou particules messagères (p. ex. l’électron et le photon, particule messagère de l’interaction électromagnétique) connues, il existe un partenaire supersymétrique ou superpartenaire (dans notre exemple, le sélectron et le photino). Dans un monde supersymétrique, ce dernier aurait une masse et une charge identiques à celles de son partenaire dans le modèle standard mais son moment angulaire (appelé spin et mesuré en unité de la constante de Planck) diffèrerait d’une demi-unité. Les particules de matière ont généralement un spin demi-entier, alors que les particules messagères ont un spin entier. Changer le spin d’une demi-unité équivaudrait donc à transformer une particule de matière en une particule messagère et vice versa.

particule du modèle standard,

on postule l’existence d’un

superpartenaire. Cliquer sur

l’image pour l’agrandir

Image reproduite avec l’aimable

autorisation de CERN

Mais quel lien existe-t-il entre supersymétrie et matière noire? Si la théorie de la supersymétrie est juste, alors le Big Bang devrait avoir produit nombre de particules supersymétriques. On pense que la plupart devaient être instables et qu’elles se sont désintégrées. Cependant, les particules supersymétriques les plus légères étaient peut-être stables et il se peut qu’elles subsistent dans l’Univers à ce jour, rassemblées en de larges sphères de matière noire au sein desquelles galaxies et étoiles se forment.

Pourtant, pas une de ces particules supersymétriques n’a encore été détectée. La raison, comme dans le cas du boson de Higgs, est peut-être que leurs masses sont si élevées qu’elles sont hors de portée des accélérateurs de particules moins puissants que le LHC. Cette hypothèse implique que si elles existent, même les plus légères d’entre elles doivent être très lourdes: plutôt que de posséder la même masse que leurs partenaires du modèle standard (comme proposé au départ), elles devraient donc être beaucoup plus massives que leurs consœurs. La supersymétrie offre aussi une explication à des énigmes encore plus complexes de la physique des particules. Détecter et mesurer les propriétés de ces particules dans au moins une des expériences du LHC serait une avancée de taille pour notre compréhension de l’Univers.

L’anti-monde perdu?

Jusqu’à présent, nous avons parlé de la matière, de la matière noire et de l’énergie noire… mais l’Univers primordial était constitué de bien d’autres choses: nous avons de bonnes raisons de penser qu’une petite fraction de seconde après le Big Bang, l’Univers était rempli de matière et d’antimatière en proportions égales. Lorsque des particules sont produites à partir d’une source d’énergie, comme lors du Big Bang ou de collisions à haute-énergie, elles sont toujours créées avec leurs consœurs d’antimatière. Quand une particule d’antimatière rencontre une particule de matière, les deux s’annihilent et leur masse redevient énergie. Ainsi, lors du Big Bang, matière et antimatière auraient dues être produites en quantité égale puis s’annihiler mutuellement. Et pourtant, alors que l’antimatière résultant du Big Bang a entièrement disparu, une petite portion de matière est restée intacte: c’est la raison de notre existence. Comment expliquer cela?

L’antimatière est semblable au reflet de la matière. Pour chaque particule de matière, une antiparticule existe possédant la même masse mais des propriétés contraires: par exemple, l’électron de charge négative a une antiparticule de charge positive appelé positron. L’antimatière a été postulée en 1928 par le physicien Paul Dirac. Ce dernier a développé une théorie combinant la mécanique quantique et la théorie de la relativité générale d’Einstein pour décrire les interactions des électrons se déplaçant à des vitesses proches de celle de la lumière. L’équation de base qu’il en a tiré s’avère accepter deux solutions: l’une pour l’électron et l’autre décrivant une particule de même masse mais de charge opposée (nous savons désormais qu’il s’agit du positron). En 1932, la preuve de la validité de ces hypothèses a été apportée avec la découverte du positron créé à l’état naturel dans les rayons cosmiques. Ces derniers entrent en collision à de hautes énergies avec les particules de l’atmosphère terrestre: lors de ces collisions, des positrons et des antiprotons sont produits encore aujourd’hui.

Au cours des 50 dernières années et même avant, des laboratoires tels que le CERN ont régulièrement produit des antiparticules lors de collisions, les étudiant et démontrant avec une grande précision que leurs propriétés statiques (masse, charge et moment magnétique) étaient sans nul doute similaires à celles de leurs consœurs de matière. En 1995, le CERN est devenu le premier laboratoire à créer artificiellement des antiatomes à partir d’antiprotons et de positrons.

Si les quantités de matière et d’antimatière étaient véritablement les mêmes au commencement, comment se fait-il qu’elles ne se sont pas annihilées pour ne laisser derrières elles que de la radiation? La pérennité de la matière et la disparition de l’antimatière laissent à penser qu’un déséquilibre s’est produit plus tôt dans l’histoire laissant légèrement plus de matière que d’antimatière dans l’Univers. C’est de ce résidu que les étoiles, les galaxies, et l’homme, sont constitués. Les physiciens se demandent à présent ce qui aurait pu causer ce déséquilibre.

Le LHCb, une des expériences du LHC, vise à mieux comprendre les raisons de la disparition de l’antimatière en étudiant les taux de désintégration bêta des quarks b, qui appartiennent à la troisième famille de quarks (voir le schéma du modèle standard), et en les comparant à ceux des antiquarks «b-barre». On sait déjà que ces taux de désintégrations sont différents mais on pense que des mesures plus précises fourniront des indications précieuses quant aux mécanismes spécifiques responsables du déséquilibre.

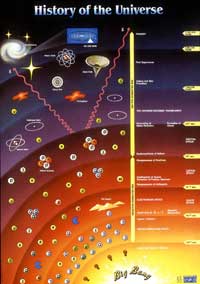

La soupe primordiale

l’Univers, du Big Bang à nos jours.

Cliquer sur l’image pour l’agrandir

Image reproduite avec l’aimable

autorisation de CERN

Pour répondre aux questions évoquées plus haut, les physiciens feront entrer en collision des protons dans le LHC. Cependant, pendant une partie de l’année, ce sont des faisceaux de ions de plomb qui seront accélérés et entreront en collisions. Les particules ainsi créées seront analysées par ALICE, la quatrième des grandes expériences prévues au LHC (avec ATLAS, CMS et LHCb).

Environ 10-5secondes après le Big Bang, lors d’une phase «ultérieure» de l’Univers, après que sa température ait chuté à «seulement» 2 000 milliards de degrés, les quarks se seraient agglutinés pour former des protons et des neutrons, à la base des futurs noyaux atomiques (voir l’image de l’histoire de l’Univers). Et c’est là qu’ils sont demeurés, liés par les gluons, particules messagères de l’interaction forte (voir le schéma du modèle standard). Cette interaction entre les quarks et les gluons augmente avec la distance au contraire des autres types d’interaction. La conséquence de cela est qu’aucune expérience n’a pu isoler de quarks ou de gluons à partir de protons, de neutrons ou de toute autre particule composite telle qu’un méson. Les physiciens disent que les quarks et les gluons sont confinés à l’intérieur de ces particules composites.

Supposons qu’il soit toutefois possible de renverser le processus de confinement. Le modèle standard prédit alors qu’à très hautes températures et très fortes densités combinées, les quarks et les gluons existeraient librement dans un état de matière autre appelé plasma de quarks et de gluons, une sorte de «soupe» chaude et dense. Une telle transition devrait survenir à des températures dépassant les 2 000 milliards de degrés, soit des températures environ 100 000 fois supérieures à celle du centre du soleil. Pendant quelques millionièmes de secondes, environ 10-6 secondes après le Big Bang, la température et la densité de l’Univers étaient effectivement suffisamment élevées pour que l’Univers tout entier ait été dans cet état de plasma de quarks et de gluons. L’expérience ALICE recréera ces conditions au sein du volume d’un noyau atomique et analysera en détails les traces produites afin de vérifier l’existence du plasma et d’étudier ses caractéristiques.

Dans le second article (Landua, 2008), Rolf Landua nous parle de la technologie utilisée au LHC et des quatre expériences, ATLAS, CMS, LHCb et ALICE.

References

- Boffin H (2008) “L’intelligence est secondaire en recherche.” Science in School 10. www.scienceinschool.org/2008/issue10/tamaradavis/french

- Jørgensen, UG (2006) Y a-t-il des planètes semblables à la Terre en orbite autour d’autres étoiles que le Soleil? Science in School 2. www.scienceinschool.org/2006/issue2/exoplanet/french

- Landua, R (2008) Voyage au cœur du LHC. Science in School 10. www.scienceinschool.org/2008/issue10/lhchow/french

- Rebusco P, Boffin H, Pierce-Price D (2007) Fusion in the Universe: where your jewellery comes from. Science in School 5: 52-56. www.scienceinschool.org/2007/issue5/fusion

- Warmbein B (2007) Making dark matter a little brighter. Science in School 5: 78-80. www.scienceinschool.org/2007/issue5/jennylist

- Westra MT (2006) Fusion dans l’univers : la puissance du Soleil. Science in School 3. www.scienceinschool.org/2006/issue3/fusion/french

Web References

- w1 – Le Prix Nobel de Physique de 2008 a été octroyé conjointement à Yoichiro Nambu «pour la découverte du mécanisme de brisure spontanée de symétrie dans la physique subatomique» et au tandem Makoto Kobayashi et Toshihide Maskawa «pour la découverte de l’origine de la brisure de symétrie qui prédit l’existence d’au moins trois familles de quarks dans la nature». Pour plus de détails sur ces travaux, voir: http://nobelprize.org/nobel_prizes/physics/laureates/2008/press.html

Resources

Une description bien plus détaillée du modèle standard et des expériences du LHC est donnée dans le livre en allemand de Rolf Landua:

- Landua R (2008) Am Rand der Dimensionen. Frankfurt, Germany: Suhrkamp Verlag

- Le site web de la NASA présente une belle description de la théorie du Big Bang: http://map.gsfc.nasa.gov/universe/bb_theory.html

- Le site web Particle Adventure propose des enseignements dont une intéressante explication du modèle standard: http://particleadventure.org

Pour plus de détails sur le Boson de Higgs, voir:

- The Heart of the Matter: Inside CERN: www.exploratorium.edu/origins/cern/ideas/higgs.html

- Les pages interactives du National Geographic sur le Boson de Higgs: http://ngm.nationalgeographic.com/2008/03/god-particle/particle-interactive.html

- L’article du National Geographic sur la question: http://ngm.nationalgeographic.com/2008/03/god-particle/achenbach-text

Pour plus de détails sur l’antimatière, voir:

- L’émission en directe sur le site web du CERN, qui explique ce qu’est l’antimatière, où elle a été créée et comment elle fait déjà partie de nos vies: http://livefromcern.web.cern.ch/livefromcern/antimatter

- Le site web du CERN qui proposent des informations sur Anges et Démons et des études scientifiques faites sur l’antimatière: http://public.web.cern.ch/Public/en/Spotlight/SpotlightAandD-en.html

- Le site web officiel du film Anges et Démons: http://www.angelsanddemons.com

- Un portail des dix premiers sites web dédiés à l’antimatière: www.anti-matter.org

- Une vidéo en ligne produite conjointement par la BBC, l’OU et VEGA expliquant ce qu’est l’antimatière: www.vega.org.uk/video/programme/14

- Pour une introduction à la supersymétrie, voir: http://hitoshi.berkeley.edu/public_html/susy/susy.html

Pour plus de détails sur la matière et l’énergie noires, voir:

- Des ressources, fournies par l’Institut Perimeter pour la physique théorique, pour enseigner ce qu’est la matière noire: http://www.perimeterinstitute.ca/Perimeter_Explorations/

- The_Mystery_of_Dark_Matter/The_Mystery_of_Dark_Matter

- Une vidéo sur les preuves de l’existence de la matière noire, telles que révélées par le télescope spatiale Hubble, sur le site web Space.com: www.space.com/common/media

- /video.php?videoRef=150407Dark_matter

- Une vidéo retraçant les recherches de la physicienne Patricia Burchat sur la matière et l’énergie noires: www.ted.com/index.php/talks/

- patricia_burchat_leads_a_search_for_dark_energy.html

- Un article expliquant ce qu’est l’énergie noire sur le site web Physics World: http://physicsworld.com/cws/article/print/19419

- Pour des informations sur le plasma de quark et de gluon, notamment sous la forme d’un dessin animé (disponible en anglais, français, italien et espagnol) sur la soupe de quarks et de gluons, voir l’espace enfants du site web de l’expérience ALICE: http://aliceinfo.cern.ch/Public/Welcome.html